torchvision

一、简介

tochvision主要处理图像数据,包含一些常用的数据集、模型、转换函数等。torchvision独立于PyTorch,需要专门安装。

torchvision主要包含以下四部分:

- torchvision.models: 提供深度学习中各种经典的网络结构、预训练好的模型,如:Alex-Net、VGG、ResNet、Inception等。

- torchvision.datasets:提供常用的数据集,设计上继承 torch.utils.data.Dataset,主要包括:MNIST、CIFAR10/100、ImageNet、COCO等。

- torchvision.transforms:提供常用的数据预处理操作,主要包括对Tensor及PIL Image对象的操作。

- torchvision.utils:工具类,如保存张量作为图像到磁盘,给一个小批量创建一个图像网格。

二、安装

1 | pip3 install torchvision |

torchvision要注意与pytorch版本和Cuda相匹配。

要查询pytorch和torchvision的版本,可以使用下面语句 :

1 | import torch |

三、torchvision的主要功能示例

1.加载model

1)加载几个预训练模型

通过pretrined=True可以加载预训练模型。pretrained默认值是False,不赋值和赋值False效果一样。

1 | import torchvision.models as models |

预训练模型期望的输入:

- RGB图像的mini-batch:(batch_size, 3, H, W),并且H和W不能低于224。

- 图像的像素值必须在范围[0,1]间,并且用均值mean=[0.485, 0.456, 0.406]和方差std=[0.229, 0.224, 0.225]进行标准化。

下载的模型可以通过state_dict() 来打印状态参数、缓存的字典。

1 | import torchvision.models as models |

2)只加载模型,不加载预训练参数 如果只需要网络结构,不需要训练模型的参数来初始化,可以将pretrained = False

1 | # 导入模型结构 |

3)加载部分预训练模型

实际使用中可能会对预训练模型进行调节,就是对预训练模型中的层进行修改。

下面示例中,对原模型中不匹配的键进行了删除 , 注意新模型改变了的层需要和原模型对应层的名字不一样,比如:resnet最后一层的名字是fc(PyTorch中),那么我们修改过的resnet的最后一层就不能取这个名字,可以叫fc_

1 | import torchvision.models as models |

4)调整模型

预训练的模型有些层并不是直接能用,需要我们微微改一下,比如,resnet最后的全连接层是分1000类,而我们只有21类;或resnet第一层卷积接收的通道是3, 我们可能输入图片的通道是4,那么可以通过以下方法修改:

1 | # 修改通道数 |

2.加载数据集

torchvision.datasets是从torch.utils.data.Dataset的子类,可以使用torch.utils.data.DataLoader进行多线程处理。官网参考地址:https://pytorch.org/vision/stab

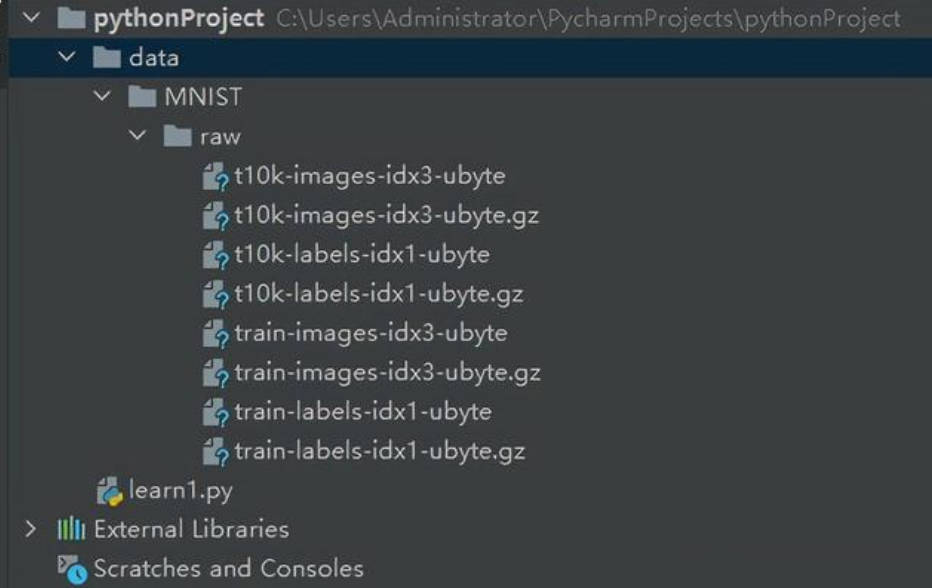

1)示例:加载MNIST

1 | from torchvision import datasets |

2)示例:加载Fashion-MNIST

1 | from torchvision import datasets |

3)ImageFolder实现数据导入

datasets.ImageFolder方法可以实现数据导入。

1 | ImageFolder(root,transform=None,target_transform=None,loader=default_loader) |

参数说明:

- root : 在指定的root路径下面寻找图片。

- transform: 接收PIL图像的函数/转换并返回已转换的版本。 可以直接使用上面的Compose方法组合需要的变换。

- target_transform :对label进行变换。

- loader: 指定加载图片的函数,默认操作是读取PIL image对象。

这个方法返回的是list,可以使用data.DataLoader转成Tensor数据。

示例:

1 | data_transforms = { 'train': transforms.Compose([ |

dataloaders 是Variable类型,可以作为模型的输入参数。

3.transforms

transforms包含了一些图像预处理操作,这些操作可以使用torchvison.transforms.Compose连在一起进行串行 操作。这些操作有:

1 | __all__ = ["Compose", "ToTensor", "ToPILImage", "Normalize", "Resize", "Scale", "CenterCrop", "Pad", |

- Compose():用来管理所有的transforms操作。

- ToTensor():把图片数据转换成张量并转化范围在[0,1]区间内。

- Normalize(mean, std):归一化。

- Resize(size):输入的PIL图像调整为指定的大小,参数可以为int或int元组。

- CenterCrop(size):将给定的PIL Image进行中心切割,得到指定size的tuple。

- RandomCrop(size, padding=0):随机中心点切割。

- RandomHorizontalFlip(size, interpolation=2):将给定的PIL Image随机切割,再resize。

- RandomHorizontalFlip():随机水平翻转给定的PIL Image。

- RandomVerticalFlip():随机垂直翻转给定的PIL Image。

- ToPILImage():将Tensor或numpy.ndarray转换为PIL Image。

- FiveCrop(size):将给定的PIL图像裁剪成4个角落区域和中心区域。

- Pad(padding, fill=0, padding_mode=‘constant’):对PIL边缘进行填充。

- RandomAffine(degrees, translate=None, scale=None):保持中心不变的图片进行随机仿射变化。

- RandomApply(transforms, p=0.5):随机选取变换。